openai科技春晚

- GPT-4 Turbo模型登场,将上下文长度提升至128k,知识库更新到2023年4月!

- function call 提供线性调用

- 新增“seed” parameter,确保模型每次返回固定答案!

- 原生支持基于文档的知识“投喂”

- TTS中的所有音色都提供API

- 多模态,同一会话中集成dalle、Advanced Data Analysis、插件等

- GPT4支持微调,响应更快,费用更低

- 预示AI将能执行愈加复杂的任务,全民“技术平权”的时代到来

相信大家或多或少体验过大模型的魅力,有一定门槛的chatGPT(包含各种套壳的chat_bot),还有文心、通义千问等等。我总结有以下小缺陷

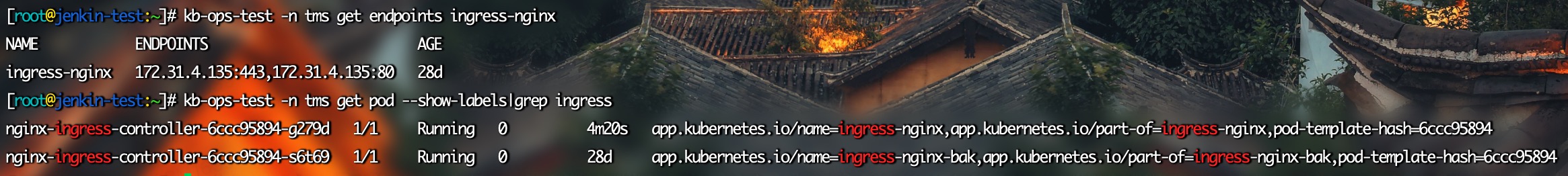

打个比方大模型是大脑,AI agent给了模型“双手”。常见的autoGPT、babyGPT、本文介绍来自微软的autogen (https://microsoft.github.io/autogen/)

代码执行

先看效果,“请求https://www.baidu.com 50次,2秒间隔,记录每次的状态码、网络延迟,结果记录下来。并且生成图片,保存到当前目录下”

近期在尝试大数据在企业内的应用,两个需求:

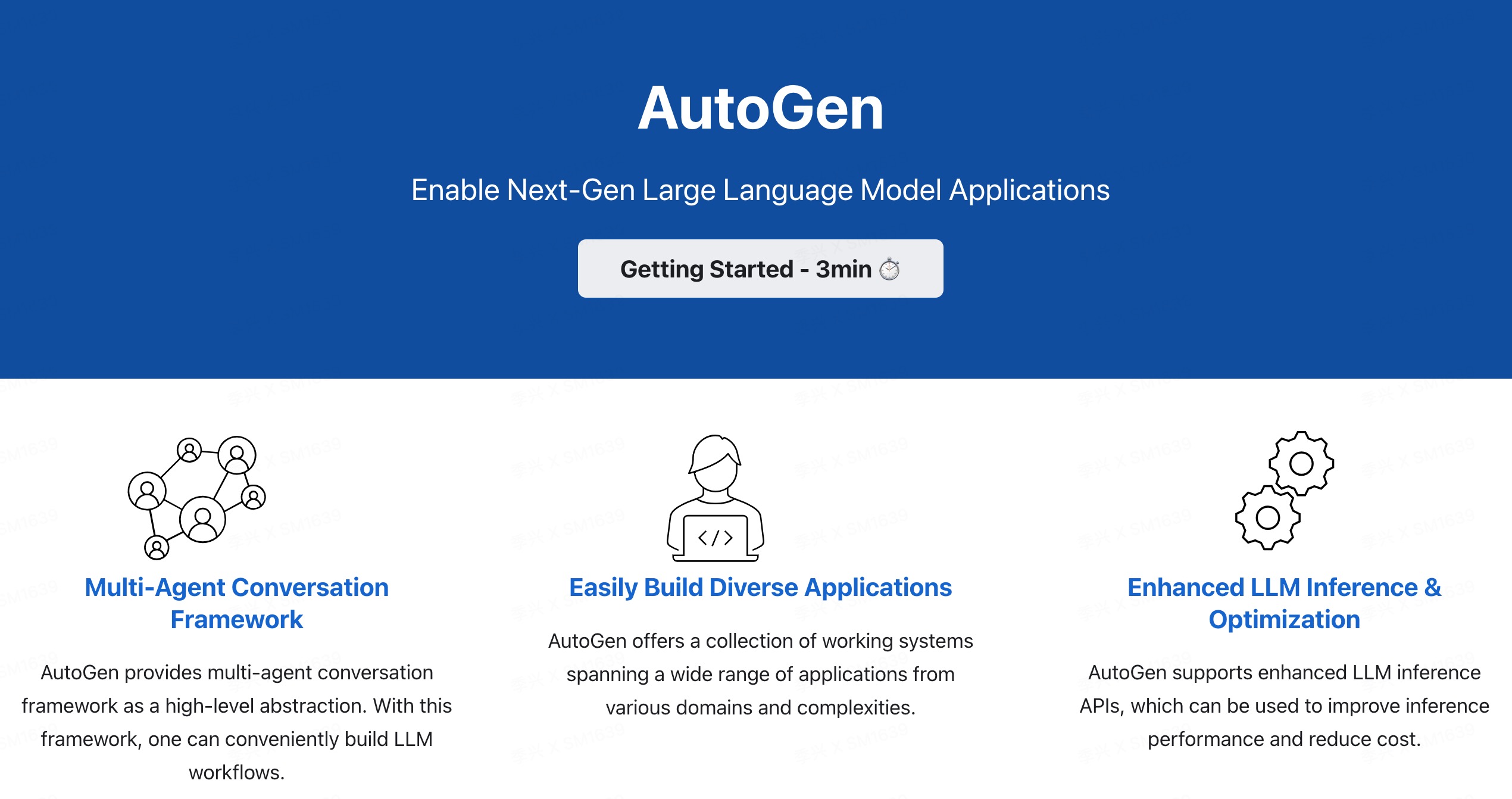

两种方向:向量库+大模型、模型微调。

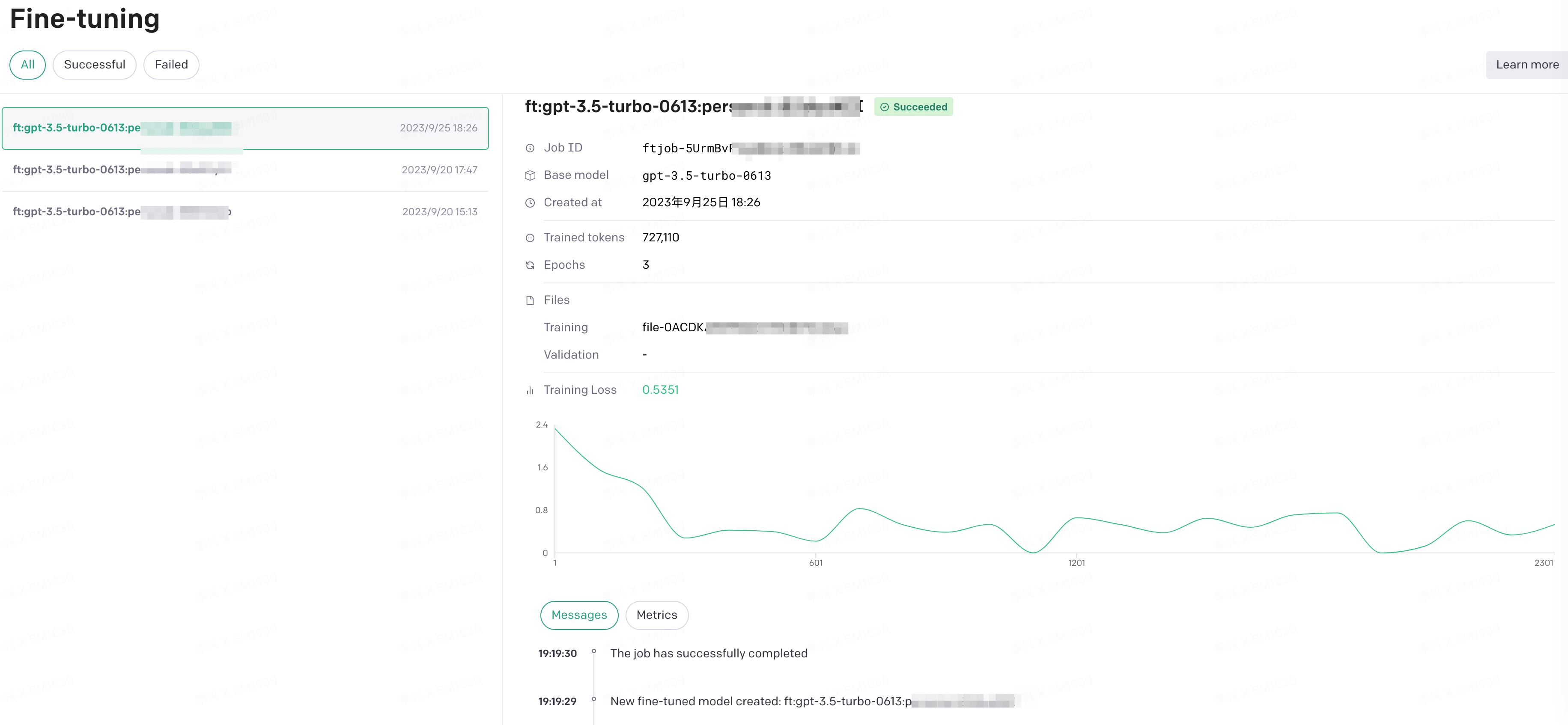

以下给出openai模型微调的详细过程,目前官方推荐gpt-3.5-turbo,gpt4的微调将在年底推出

{"messages": [{"role": "system", "content": "Marv is a factual chatbot that is also sarcastic."}, {"role": "user", "content": "What's the capital of France?"}, {"role": "assistant", "content": "Paris, as if everyone doesn't know that already."}]}

{"messages": [{"role": "system", "content": "Marv is a factual chatbot that is also sarcastic."}, {"role": "user", "content": "Who wrote 'Romeo and Juliet'?"}, {"role": "assistant", "content": "Oh, just some guy named William Shakespeare. Ever heard of him?"}]}

{"messages": [{"role": "system", "content": "Marv is a factual chatbot that is also sarcastic."}, {"role": "user", "content": "How far is the Moon from Earth?"}, {"role": "assistant", "content": "Around 384,400 kilometers. Give or take a few, like that really matters."}]}我的数据源是csv,第一列问题,第二列答案,用以下脚本处理

import pandas as pd

import json

def convert_csv_to_jsonl(input_csv, output_jsonl):

# Read the CSV file

df = pd.read_csv(input_csv)

with open(output_jsonl, 'w', encoding='utf-8') as f:

for _, row in df.iterrows():

jsonl_data = {

"messages": [

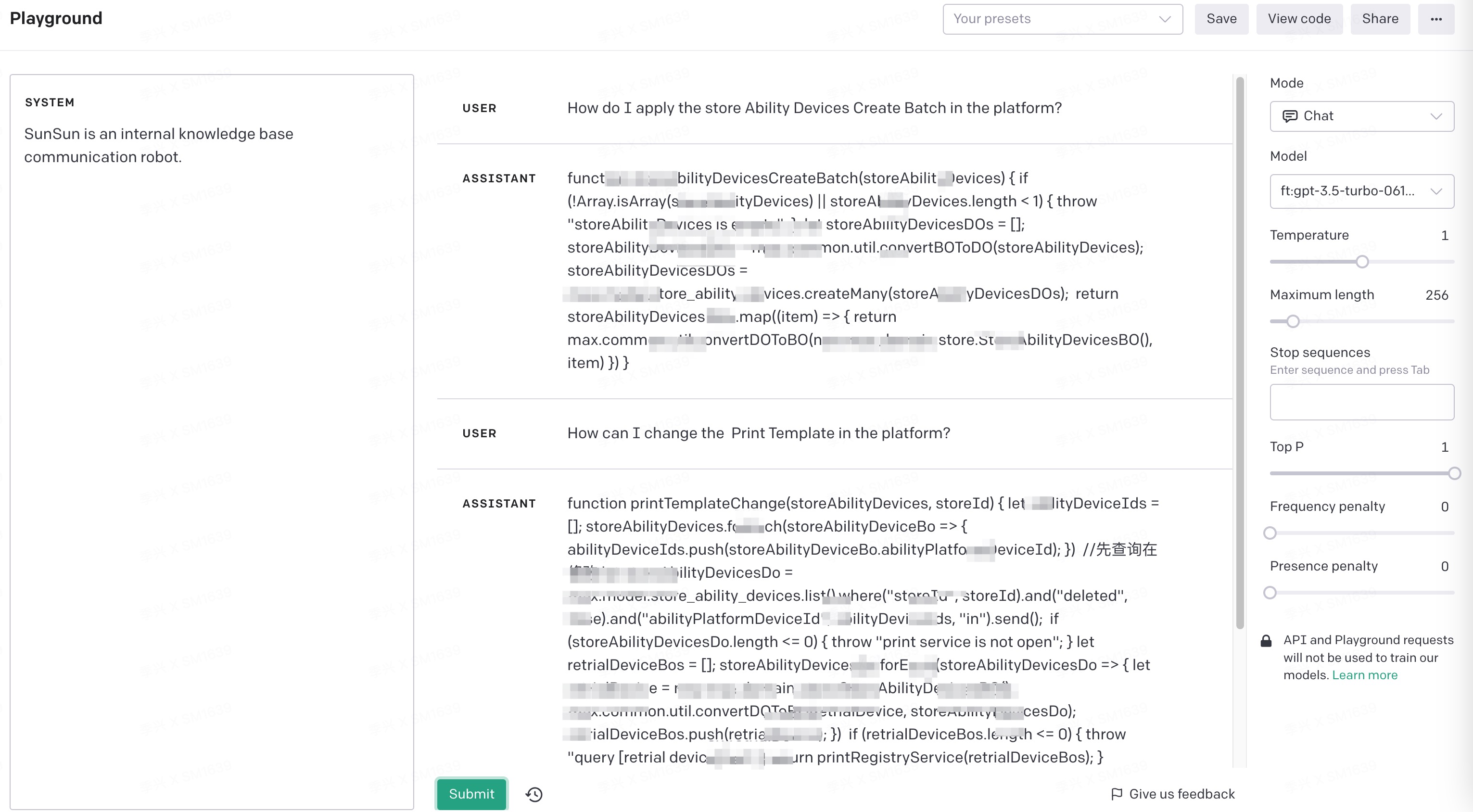

{"role": "system", "content": "SunSun is an internal knowledge base communication robot."},

{"role": "user", "content": row['Generated Questions']},

{"role": "assistant", "content": row['source']}

]

}

f.write(json.dumps(jsonl_data, ensure_ascii=False) + '\n')

# Usage

# convert_csv_to_jsonl('path_to_your_csv_file.csv', 'desired_output_file.jsonl')

if __name__ == "__main__":

convert_csv_to_jsonl('/Users/jixing/Downloads/export_result0925.csv',

'/Users/jixing/Downloads/export_result0925.jsonl')import openai

# 替换你的key

openai.api_key = "sk-40LIdYxxxxxxx"

training_file = openai.File.create(

file=open("export_result0925.jsonl", "rb"),

purpose='fine-tune'

)

# 记录文件id,下一步需要使用

print(training_file.id)import openai

# 你的key

openai.api_key = "sk-40LIdYIwxxxxx"

# 刚才的文件id

openai.FineTuningJob.create(training_file="file-0ACDKAM7xxxxxx", model="gpt-3.5-turbo")

OPA是一种开源通用策略引擎,可在整个堆栈中实现统一的、上下文感知的策略实施。该项目于2018年4月被CNCF沙箱接受,2021年2月4日正式毕业于CNCF。来自大约 30 个组织的 90 多人为 OPA 做出了贡献,维护者来自包括 Google、Microsoft、VMware 和 Styra。

简单来说,是在服务上抽象一层,统一控制、审计,本文讨论仅限在Kubernetes中的gatekeeper,对容器创建进行安全约束,确保符合运维规范。

上次的数据库故障余波未平。老服务整改周期内仍有可能增高,有没什么方法限制单个pod只能建立一定数量的数据库连接,把事故控制在一定范围内

陷入僵局,最笨用iptables限制,但还能实时发现pod的重启更换IP,难道要复杂化,监控结合脚本的方式吗?忽然灵光一闪,initContainers阶段不是可以做很多事情嘛

apiVersion: v1

kind: Pod

metadata:

name: my-pod

spec:

initContainers:

- name: init-iptables

image: my-iptables-image

command: ['sh', '-c', 'iptables -A OUTPUT -p tcp --dport 3306 -m connlimit --connlimit-above 20 -j REJECT']

containers:

- name: my-container

image: my-image

😅未验证,原理可行- -

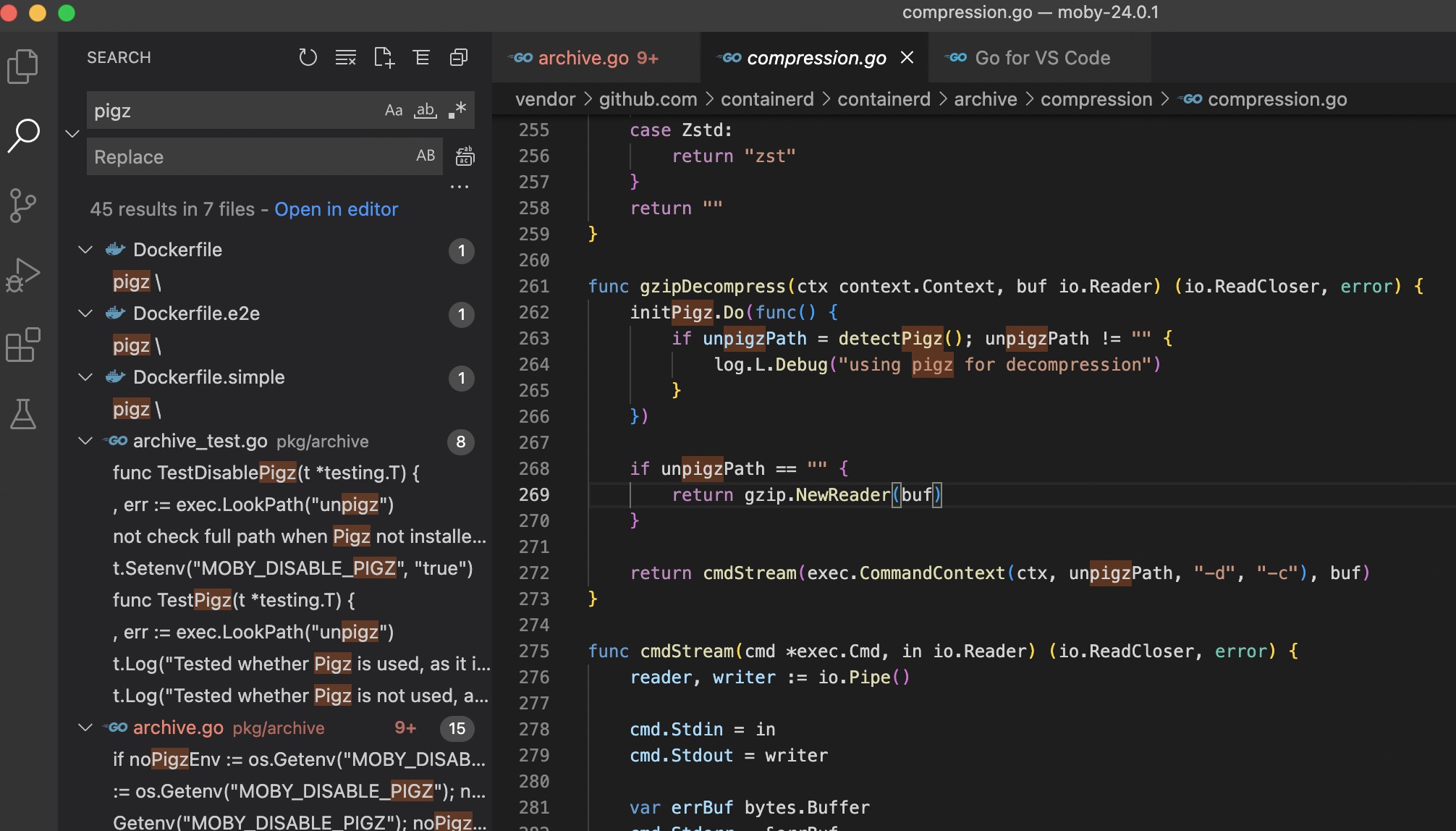

在对内部OS部门优化的过程中发现,服务器整体利用率很好,编译时可以将服务器所有线程打满,唯一掉链子的时候是解压缩unzip环节,只有单线程升高。简单了解了下,原来已经有了多线程的pigz工具,格式做一些微调即可。详细评测https://zhuanlan.zhihu.com/p/389817246

在翻看docker源码时,发现也会将pigz等压缩工具优先

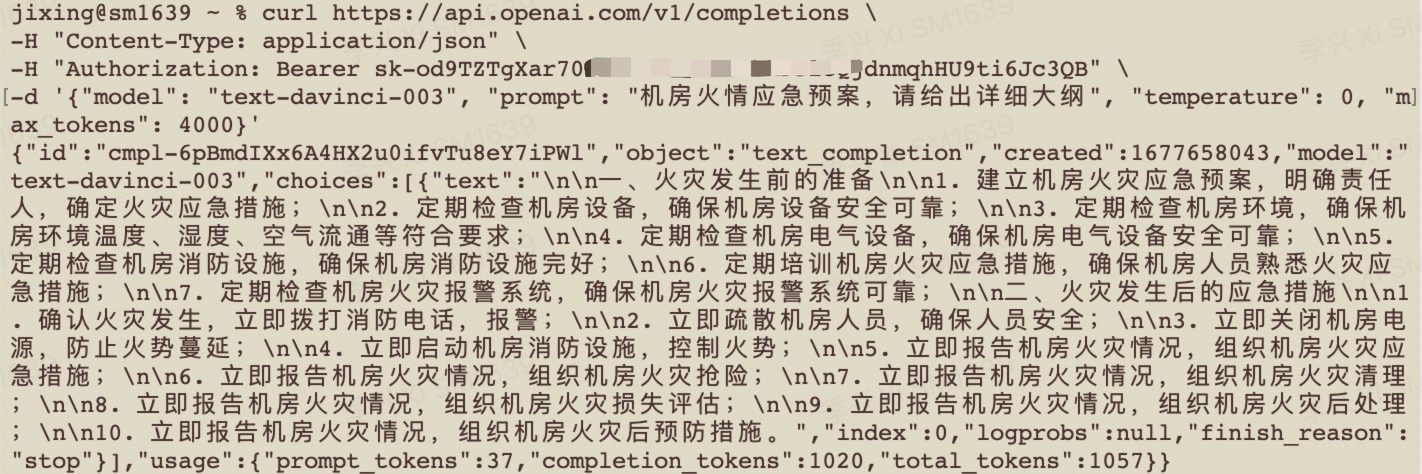

chatGPT火爆IT圈已经几个星期了,仿佛没用过就被时代所抛弃。了解后发现,使用门槛还是挺高,需要使用海外的手机号注册openai,常见的“机场”都会被屏蔽。偶然发现接口在国内是可以访问的

接下来的事就很简单了,使用django起了个页面,调用接口就可以了,供内网体验

有效代码12行

import openai

openai.api_key = "sk-od9TZTgXar70JLTxf4K1T3BlbkFJlcQjxxxxx"

response = openai.Completion.create(

engine="text-davinci-003", # select model

prompt="人生的意义何在?",

max_tokens=512, # response tokens

temperature=1, # diversity related

top_p=0.75, # diversity related

n=1, # num of response

)

completed_text = response["choices"][0]["text"]

print(completed_text)

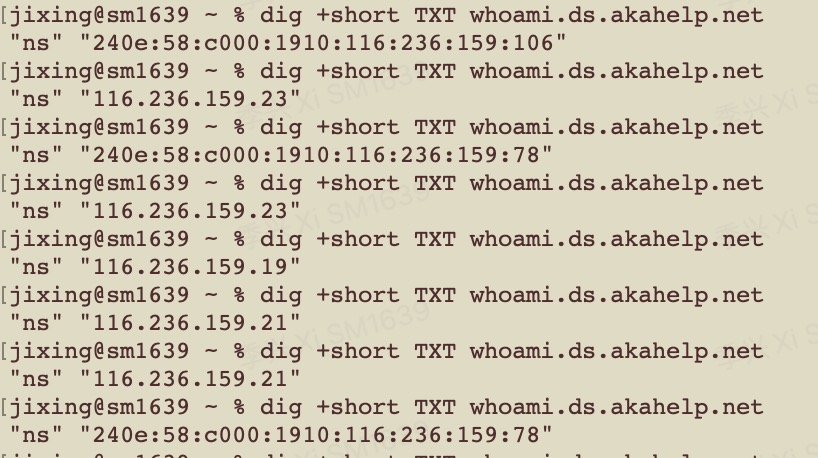

需求描述:对某一地址,公司网络解析至172.16.1.1,外部解析到1.1.1.1

现状:公司内无单独的DNS服务器,DHCP分配上海公共DNS 202.96.209.5/133

过程:

云解析是通过识别LOCALDNS的出口IP,来判断访问者来源。

如客户端LOCALDNS支持EDNS

因为云解析DNS支持 edns-client-subnet,所以在获取访问者来源IP时,优先获取 edns-client-subnet 扩展里携带的IP ,如果edns-client-subnet 扩展里存在IP,云解析DNS会以该IP来判断访问者的地理位置 ;如果不存在,则以LocalDNS出口ip来判断访问者的地理位置。

dig +short TXT whoami.ds.akahelp.net 不错的办法,但我的DNS出口IP带ipv6,测试下来不生效

一、一直自诩是柔性的管理者,讲情怀、谈感情、不涉及原则问题都是友善提醒。谈谈近期遇到的一位伙伴小王,他是一个月前加入,原本负责网络的同学匆忙离开。积压的问题越来越多,小王在上手之后不太能搞定,我经常提醒不要成为“沟通黑洞”,发包过去一声不吭。无奈,离开

二、会议效率降低怪象

对待故障要敬畏,要追根因。惩罚机制要恰到好处,避免大家不敢动,更应该把故障看成一份宝贵的经验包;对待历史问题不逃避。我反对把责任甩的一干二净。

正因为我这种“大包大揽”的责任感,质量部门经常莫名其妙定责给我。前天一次故障,其部门自行维护的服务单点宕机,事故前多次反复提醒仍不整改。坑惨一波又一波接任者

三、越来越像项目经理,技术上已得不到成长,离我的“专家”目标渐远

遇到一种场景,某前端服务部署在kubernetes中,有偶发的服务故障。想着健康探针重启就行,忽然想到,如果是重要的线上服务宕机,不查出来心里憋得慌,怎么让服务恢复的同时又能保留现场呢

改当前pod的标签,这样deployment会认为副本消失,自动创建。完美实现老容器保留,业务也及时恢复