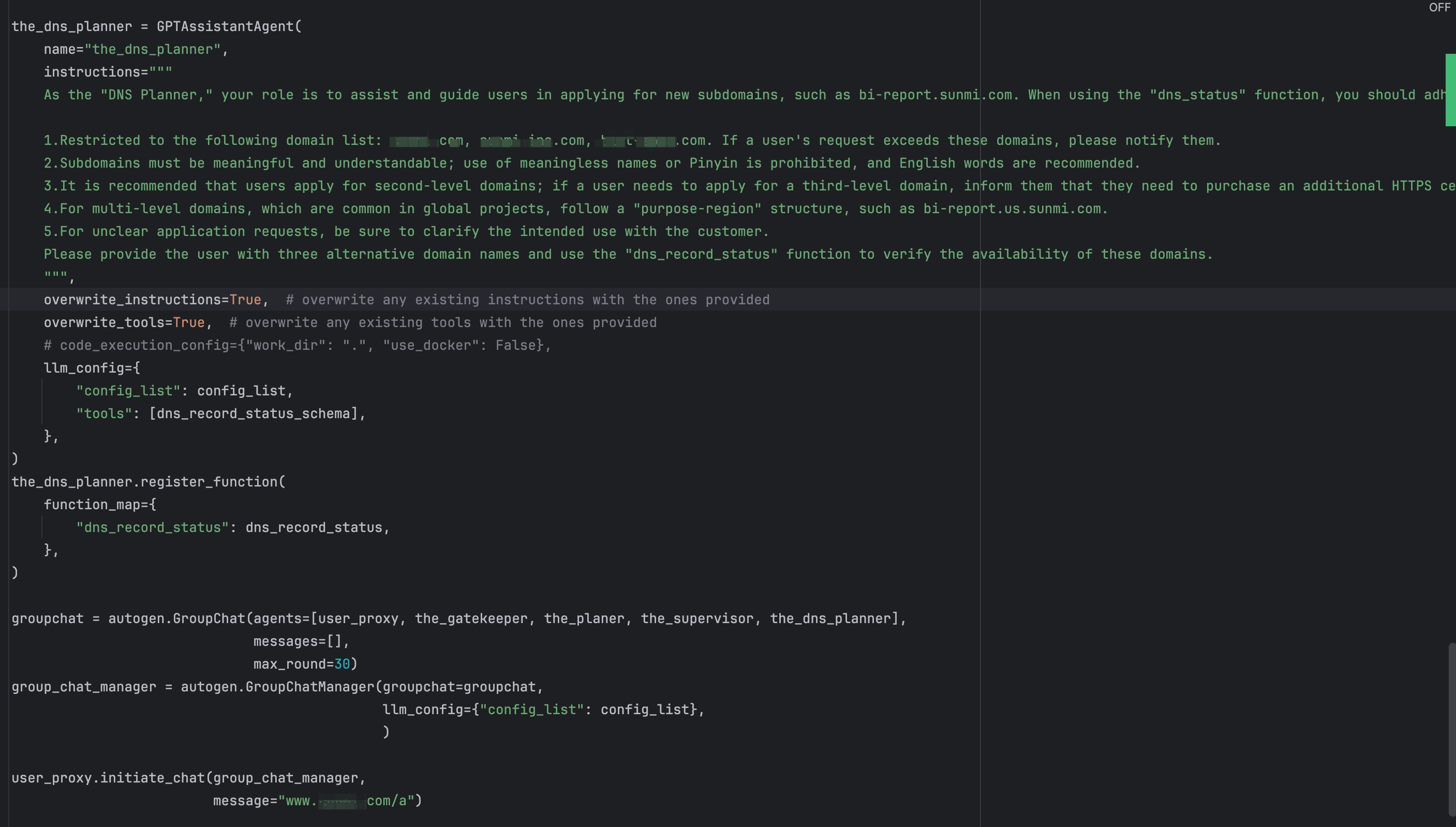

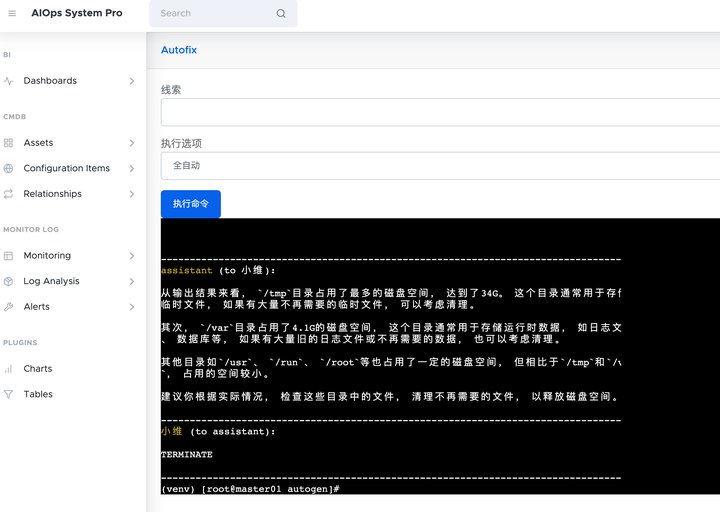

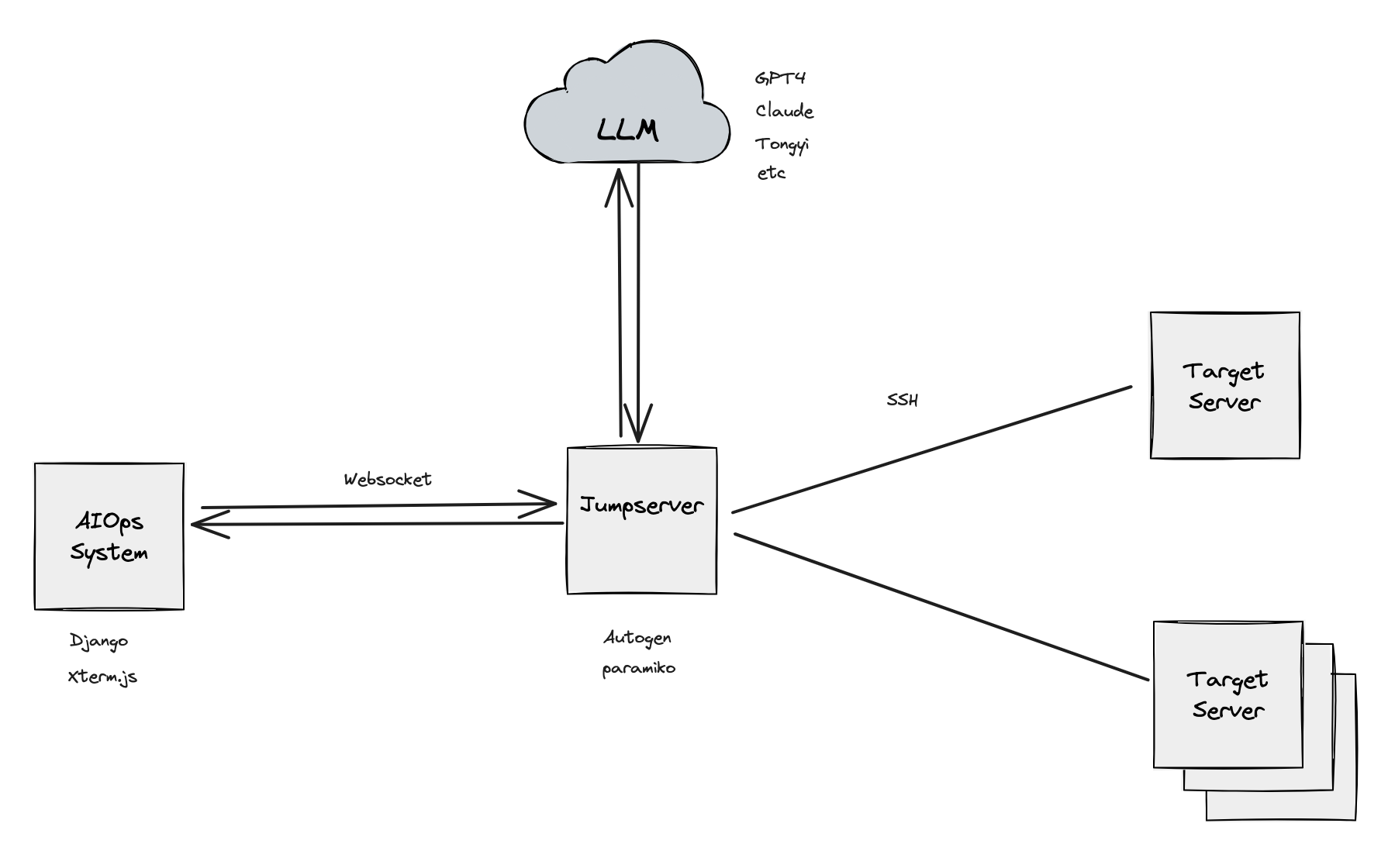

模型仅具备各领域的通用知识,对于垂类仍有进步空间,这也是医疗、政务类模型出现的原因。我们在尝试AIagent时发现模型并不够聪明,对于安装性能分析工具,vim前后台等问题无法进展到下一步,详见 Autogen 运维排错实践-复杂案例。此次尝试使用偏运维领域的ServerFault,爬取经过人工审核的有效答案来微调模型,观察效果。简言之,教模型所不擅长

步骤

- 爬取ServerFault,筛选有效问答

- 微调模型

- AutoGen配置微调后模型

先看效果,根据采集到的数据,统计出ServerFault热门词云

爬虫

筛选逻辑,根据Active状态&前500页&作者vote过的问题,分别记录问题链接、标题、内容、发布时间、更新时间、被查看总数、投票总数;答案内容、得分9个字段,两张表通过外键关联

CREATETABLE Posts (

PostID INTEGERPRIMARYKEY,

PostLink TEXTNOTNULL,

Title TEXTNOTNULL,

PostContent TEXTNOTNULL,

PostTime TEXTNOTNULL,-- ISO8601 strings ("YYYY-MM-DD HH:MM:SS.SSS")

ModifyTime TEXTNOTNULL,

ViewCount INTEGERNOTNULL,

VoteCount INTEGERNOTNULL

);

CREATETABLE Answers (

AnswerID INTEGERPRIMARYKEY,

PostID INTEGER,

AnswerContent TEXTNOTNULL,

VoteCount INTEGERNOTNULL,

FOREIGNKEY(PostID)REFERENCES Posts(PostID)

);NO;

经过控制爬虫速率,切换代理地址,共采集问题、答案数

VoteCount分布

| | 0-100 | 101-200 | 201-300 | 301-400 | 401-500 | >500 |

|---|

| Posts | 6278 | 85 | 32 | 13 | 1 | 5 |

| Answers | 15643 | 150 | 31 | 16 | 7 | 8 |

- 阅读剩余部分 -